Un siècle d'évolution dans le matériel des caméras de sécurité et l'optique d'imagerie

La préhistoire mécanique : de l’enregistrement cinétique aux prototypes en circuit fermé

Le parcours technique des caméras de sécurité n’a pas été un succès du jour au lendemain mais une évolution interdisciplinaire s’étalant sur deux siècles. Ses racines remontent à la fin du XIXe siècle, avec les premières tentatives de capture d'images dynamiques continues. En 1870, l'inventeur anglais Wordsworth Donisthorpe a breveté le « kinésigraphe », une caméra cinématographique conçue pour prendre une série de photos à intervalles définis afin de capturer le mouvement.1En 1889, Donisthorpe et Louis Le Prince perfectionnèrent davantage les caméras argentiques et la technologie de projection ; Le Prince a même développé une caméra à 16 objectifs qui, bien qu’à l’époque plutôt un outil expérimental, a jeté les bases physiques d’une surveillance continue dans des espaces spécifiques.1

Le premier véritable système de télévision en circuit fermé (CCTV) est né des besoins militaires pendant la Seconde Guerre mondiale. En 1942, l'ingénieur allemand Walter Bruch fut chargé de concevoir et de superviser un système permettant de surveiller les lancements de fusées A4 (V-2) depuis un bunker sécurisé.1Le cœur de ce système était sa nature « en circuit fermé », ce qui signifie que les signaux vidéo étaient transmis uniquement à des moniteurs prédéfinis et non publics. La technologie d’imagerie de l’époque reposait entièrement sur des tubes à vide volumineux et des circuits analogiques complexes, sans aucun moyen d’enregistrement. Le personnel de sécurité devait surveiller les moniteurs en temps réel, car les informations étaient perdues à jamais une fois l'image disparue.2

En 1949, la société américaine Vericon lance le premier système commercial de vidéosurveillance, marquant la transition du secteur militaire vers le secteur commercial et civil.3Ces premiers systèmes commerciaux utilisaient principalement des caméras fixes noir et blanc connectées via des câbles coaxiaux. En raison de la chaleur élevée, de la consommation d'énergie élevée et des exigences de 110 V CA des tubes à vide, l'installation était strictement limitée, exigeant souvent que la caméra se trouve à moins de 6 pieds d'une prise de courant.5De plus, les performances optiques étaient extrêmement limitées, avec des résolutions autour de seulement 240 lignes.

Le pic et les périls des tubes à vide : Vidicons contre Plumbicons

Avant que la technologie d’imagerie à semi-conducteurs n’arrive à maturité, les tubes à vide (Pick-up Tubes) constituaient l’unique noyau des caméras de sécurité. Ces appareils étaient essentiellement des tubes cathodiques (CRT) fonctionnant en sens inverse. Dans les années 1950, Weimer, Forgue et Goodrich de RCA ont développé le Vidicon, un tube de caméra de type stockage utilisant un semi-conducteur photosensible (initialement du trisulfure d'antimoine) comme cible.7

Mécanisme physique et limitations matérielles

Le principe de fonctionnement d'un tube photographique consiste à focaliser une scène sur une cible photosensible via une lentille optique, qui est ensuite balayée par un faisceau d'électrons à faible vitesse provenant d'un canon à électrons. Lorsque la lumière atteint la cible, la conductivité locale change, provoquant une fluctuation du courant du faisceau électronique et convertissant la lumière en signaux vidéo.8Le Vidicon a considérablement réduit la taille et le coût des caméras, ce qui en fait la norme pour la surveillance hors diffusion.7

Cependant, le Vidicon souffrait d'un défaut mortel de « burn-out ». Si elle est pointée trop longtemps vers le soleil, des surfaces hautement réfléchissantes ou des points lumineux, la cible photosensible subirait des dommages physiques permanents, créant des « angles morts ».8De plus, les Vidicons étaient sensibles à « l'effet microphonique », où des bruits forts ou des explosions provoquaient des vibrations physiques dans la cible à couche mince, produisant des barres horizontales sur l'écran.8

Pour surmonter la faible sensibilité et les « traînées » importantes (queues de comètes) du Vidicon, Philips a introduit le Plumbicon dans les années 1960. Utilisant l'oxyde de plomb comme cible, le Plumbicon offrait des rapports signal/bruit élevés et un décalage d'image extrêmement faible.7Bien qu'il réussisse en radiodiffusion, son coût élevé limitait son utilisation en matière de sécurité aux applications haut de gamme. Ce n'est qu'à la fin des années 1970, avec l'évolution des technologies à faible luminosité comme le Tivicon (tube à diode en silicium) et le Newvicon (produit par Panasonic), que les tubes à vide ont répondu aux besoins fondamentaux de la surveillance nocturne.10

Le tableau ci-dessous résume l'évolution des premières caméras de sécurité à tube à vide :

| Phase technique | Capteur central | Année représentative | Lignes TV | Principales fonctionnalités | Limites |

| Initiation | Premiers tubes photoélectriques | 1942 | 100-200 | Utilisation militaire, observation en temps réel |

Extrêmement encombrant, pas d'enregistrement4 |

| Commercialisation | Vidicon | années 1950 | 240 | Structure simple, réduction des coûts |

Facile à brûler, faible sensibilité7 |

| Amélioration des performances | Plombier | années 1960 | 400+ | SNR élevé, faible décalage |

Très cher8 |

| Pic analogique | Newvicon/Saticon | années 1970 | 480-700 | Capacité précoce en basse lumière |

Toujours volumineux, dépendant de l'alimentation secteur10 |

Le moment Nobel du silicium : la naissance et le règne du CCD

L’année 1969 marque une étape importante dans l’histoire de l’imagerie moderne. Willard Boyle et George Smith des Bell Labs ont inventé le dispositif à couplage de charge (CCD), une réalisation qui leur a valu plus tard le prix Nobel de physique.13Le CCD a révolutionné le matériel des caméras de sécurité, en remplaçant les tubes à vide fragiles par des puces de silicium à semi-conducteurs.13

L’art du couplage de charge : l’analogie du seau d’eau

Le principe de fonctionnement d'un CCD peut être comparé à un « réseau de seaux récupérant l'eau de pluie ». Chaque pixel (atome de silicium) du capteur agit comme un seau collectant des photons (gouttes de pluie). L'effet photoélectrique convertit les photons en photoélectrons, qui sont stockés dans des puits de potentiel. Pendant la phase de lecture, ces charges sont déplacées ligne par ligne comme une course de relais vers un amplificateur de lecture et converties en tension.13L'avantage du CCD réside dans sa grande uniformité d'image et son faible bruit de motif, car tous les pixels partagent généralement un à quatre amplificateurs de lecture, garantissant ainsi la cohérence.13

Fairchild Semiconductor a lancé le premier CCD commercial au monde, le MV-100, en 1973, avec une résolution de seulement 100 x 100 pixels.14Initialement destinée à un usage industriel et militaire, elle a ouvert la voie aux caméras de sécurité « de poche ».16Sony a investi la somme colossale de 20 milliards de yens en R&D tout au long des années 1970, pour finalement commercialiser la caméra CCD couleur XC-1 en 1980.18Cette décision, considérée à l'époque comme un pari suicidaire, a fait de Sony la force dominante sur le marché mondial des capteurs d'image pendant des décennies.19

L'âge d'or de la surveillance analogique et de l'évolution des PCB

Durant le règne du CCD dans les années 1980 et 1990, l'électronique interne des caméras a également subi des changements radicaux. La technologie des cartes de circuits imprimés (PCB) est passée du papier phénolique aux substrats en fibre de verre, améliorant considérablement la stabilité thermique et l'intégrité du signal.6Dans les années 1970, les PCB ne prenaient en charge que le câblage unilatéral ; dans les années 1980, les PCB double face permettaient d'intégrer davantage de composants de traitement du signal (comme les premiers processeurs vidéo) dans de petits boîtiers de caméra.6Durant cette période, les systèmes de sécurité utilisaient des câbles coaxiaux pour transmettre des signaux analogiques, avec une résolution atteignant la limite physique de la technologie analogique : environ 700 lignes TV (TVL).5

CMOS APS et la révolution numérique : de la « capture » au « calcul »

Même si le CCD a longtemps dominé en matière de qualité d'image, sa fabrication complexe, sa consommation d'énergie élevée et son incapacité à intégrer des circuits logiques limitaient l'intelligence de la caméra. Au milieu des années 1990, la technologie des capteurs de pixels actifs à semi-conducteurs complémentaires (CMOS APS) a commencé à mûrir.13

La bataille architecturale : CMOS contre CCD

Contrairement à la « lecture série » du CCD, chaque pixel d'un capteur CMOS possède son propre amplificateur et son propre circuit de lecture. Cette architecture apporte de multiples avantages techniques :

-

Haute intégration :Les processeurs de signaux d'image (ISP), les convertisseurs analogique-numérique (ADC) et les circuits de contrôle de synchronisation peuvent être intégrés sur la même puce en silicium, formant un système sur puce (SoC).21

-

Ultra-haute vitesse :Avec des milliers de canaux de lecture, les vitesses CMOS peuvent être 100 fois plus rapides que celles du CCD, permettant une surveillance à fréquence d'images élevée (60 ips ou plus) et une lecture au ralenti.13

-

Contrôle de puissance :Le CMOS consomme une énergie importante uniquement lors de la commutation des pixels, ce qui réduit considérablement la chaleur, un facteur critique pour les opérations de sécurité 24h/24 et 7j/7.13

En 2007, le CMOS a atteint la parité du marché avec le CCD, et en 2019, grâce à la popularité de la technologie rétro-éclairée (BSI), les performances du CMOS ont dépassé le CCD.13BSI réorganise les couches de capteurs afin que la lumière atteigne la photodiode avant la couche de circuit, augmentant ainsi considérablement l'efficacité quantique (QE) et jetant les bases de la surveillance « Starlight ».14

Le tableau ci-dessous compare les CCD et CMOS dans les applications de sécurité modernes :

| Paramètre | Capteur CCD | Capteur CMOS (APS) | Impact sur les tendances |

| Vitesse de lecture | 1 à 40 MPS | 100 à 400+ MPS |

Streaming vidéo HD activé13 |

| Lire le bruit | 5 à 10 électrons | 1 à 3 électrons |

Clarté améliorée en basse lumière13 |

| Plage dynamique | Élevé (plein format) | Extrêmement élevé (HDR) |

Percées facilitées dans le cadre du WDR15 |

| Coût | Élevé (Lignes spécialisées) | Faible (CMOS standard) |

A contribué à la démocratisation de la caméra13 |

| Intégration | Faible (puces externes) | Élevé (SoC monopuce) |

Conduit aux caméras Edge AI22 |

Évolution des lentilles optiques : du verre fixe aux systèmes intelligents

Si le capteur est la « rétine » d’un appareil photo, l’objectif est sa « lentille cristalline ». En matière de sécurité, les lentilles doivent conserver leur pouvoir de résolution dans des environnements très variables.

Surmonter l'aberration : l'essor des éléments asphériques

Les premiers objectifs de surveillance étaient pour la plupart sphériques. La nature physique des lentilles sphériques signifie que les rayons lumineux sur les bords et au centre ne convergent pas au même point, provoquant une aberration sphérique et un flou des bords.26Pour résoudre ce problème, les lentilles de sécurité ont commencé à adopter en masse des éléments asphériques. Bien que la théorie ait été proposée par Descartes en 1637, ce n'est que dans les années 1980 que le moulage de précision du verre a rendu possible la production de masse, permettant des ouvertures plus grandes (F/1,4 ou F/1,0) sans sacrifier la clarté.27

Zoom et correction automatique de la mise au point arrière

Dans les années 1970, le besoin d’angles de vision flexibles a conduit à la naissance des objectifs zoom. Cependant, les zooms traditionnels perdent souvent la mise au point lors des changements de distance focale. Pour garantir la clarté, l'industrie a développé des mécanismes de « réglage de la mise au point arrière » pour maintenir la mise au point verrouillée sur le plan du capteur, du grand angle au téléobjectif.29Les zooms motorisés modernes intègrent des moteurs pas à pas de précision pour ajuster automatiquement le champ de vision en fonction des déclencheurs d'alarme.26

P-iris : résoudre le dilemme de la diffraction à l'ère de la HD

Alors que la résolution du capteur est passée de 0,3 MP à 8 MP (4K), les défauts des objectifs à iris automatique traditionnels sont apparus. Les iris DC conventionnels ajustent uniquement la taille de l'ouverture en fonction de la luminosité. dans des environnements lumineux, l'iris se ferme si étroitement qu'il provoque une diffraction importante, rendant l'image floue, un phénomène connu sous le nom de « limite optique ».30

Pour contrer cela, Axis Communications a introduit la technologie P-iris (Precise Iris). P-iris ne repose pas uniquement sur des capteurs de lumière ; il utilise un logiciel pour communiquer avec un moteur pas à pas dans l'objectif.

-

Sélection d'ouverture optimale :Le logiciel identifie le « point idéal » de l'objectif (généralement un diaphragme de milieu de gamme) et le maintient autant que possible.30

-

Lien entre gain et exposition :Lorsque la lumière est trop forte, le système privilégie une exposition plus courte ou une réduction du gain électronique plutôt que de fermer excessivement l'iris, évitant ainsi la diffraction.30

-

Profondeur de champ maximisée :Pour les scènes telles que les longs couloirs, P-iris optimise la profondeur de champ pour garantir que le premier plan et l'arrière-plan restent clairs.33

Avancement des FAI : l'essor du nerf optique numérique

Les données brutes du capteur doivent être traitées par un processeur de signal d'image (ISP) pour être visibles. L'évolution du FAI est ce qui a fait passer la surveillance de la sécurité de « voir » à « voir clairement et précisément ».

Voies techniques vers une large plage dynamique (WDR)

Dans les scènes rétroéclairées (comme une vitrine de banque), la différence entre les zones claires et sombres peut dépasser 100 000x. Les FAI gèrent cela via trois méthodes principales :

-

WDR numérique (DWDR) :Un algorithme logiciel qui ajuste les courbes gamma pour éclaircir les zones sombres. Faible coût mais bruit élevé.35

-

Véritable WDR (fusion multi-exposition) :La solution haut de gamme grand public. Le FAI demande au capteur de prendre deux images en succession rapide : une exposition courte (hauts points) et une exposition longue (ombres). L’enregistrement au niveau des pixels les fusionne ensuite de manière transparente.36

-

WDR médico-légal :Une version optimisée pour réduire les artefacts de mouvement, garantissant que les objets en mouvement ne présentent pas de « fantômes », ce qui est essentiel pour la reconnaissance des plaques d'immatriculation.25

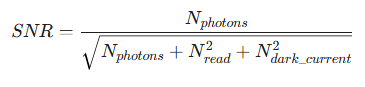

Le rapport signal sur bruit (SNR) dans les algorithmes des FAI peut être décrit par :

Percées en matière de faible luminosité extrême : Starlight et Blacklight

La dernière frontière de la sécurité est l’obscurité. La vision nocturne infrarouge traditionnelle entraîne une perte de couleur, rendant impossible l'identification des couleurs des vêtements ou des véhicules.40

Les trois piliers matériels des caméras « Starlight »

Le succès de Starlight repose sur le fait de repousser les limites physiques :

-

Capteurs grand format :Utilisation de capteurs 1/1,8 pouces voire 1/1,2 pouces. Cela augmente la zone de réception de lumière par pixel, capturant ainsi plus de photons.39

-

Optique à très grande ouverture :Équipé d'objectifs F/1.0 ou F/0.95, offrant 4 fois plus de lumière que les objectifs F/2.0 standard.26

-

Algorithmes d'obturation lente :Empilement des trames dans le FAI pour augmenter le temps d'intégration. Bien que cela introduit un certain flou de mouvement, cela produit des images couleur semblables à celles du jour dans des environnements de 0,001 Lux.24

Blacklight (DarkFighter X) Fusion à double capteur

Lorsque la lumière descend en dessous de 0,0001 Lux, le gain seul est insuffisant. Des fabricants comme Hikvision (DarkFighter X) et Keda ont lancé la technologie Blacklight, qui imite les bâtonnets et les cônes de l'œil humain :

-

Division optique :Un prisme spécialisé divise la lumière en chemins infrarouges et visibles.44

-

Doubles capteurs :Un capteur capture l'IR (luminance et détails), tandis que l'autre capture la faible lumière visible (couleur).

-

Fusion au niveau des pixels :Le FAI adapte les deux chemins en temps réel, produisant une vidéo lumineuse, en couleur et à faible bruit. Cela nécessite une précision d’étalonnage inférieure au pixel.44

Synergie multi-objectifs et imagerie informatique : une nouvelle ère

La surveillance moderne va au-delà d’une perspective unique vers des plates-formes de fusion multi-capteurs.

Épissage panoramique (PanoVu) et liaison à double objectif (TandemVu)

Pour couvrir de vastes zones comme les places ou les aéroports, la série PanoVu de Hikvision intègre 4 à 8 capteurs. Les algorithmes du FAI effectuent une « assemblage transparent », qui comprend :

-

Cohérence de l'exposition :Garantir que la luminosité est uniforme sur tous les capteurs.45

-

Enregistrement des pixels :Élimine les angles morts et les images fantômes au niveau des coutures.45

-

Surveillance multidirectionnelle :Une adresse IP et un câble peuvent gérer une vue à 360 degrés, réduisant ainsi les coûts du système.47

Photographie informatique et éclairage intelligent

L’imagerie informatique brouille la frontière entre le matériel et les logiciels.

-

Lumière hybride intelligente :Des caméras comme la Smart Hybrid Light de Hikvision utilisent l'IA pour passer du mode IR discret au mode couleur lumière blanche lorsqu'une personne ou un véhicule est détecté.41

-

Fusion multispectrale :Fusion de la lumière thermique (LWIR) et visible. Le thermique détecte la chaleur (cibles cachées), tandis que le visible les identifie, améliorant considérablement la précision de la protection périmétrique.51

Vision 2030 : l’avenir disruptif du matériel de sécurité

À l’horizon 2030, la forme des caméras de sécurité connaîtra un autre changement qualitatif.

Imagerie sans lentille et capteurs quantiques

Les recherches suggèrent que les « caméras sans objectif » basées sur l’optique informatique arrivent à maturité. En utilisant de fins encodeurs optiques au lieu de lentilles en verre, les appareils photo peuvent devenir aussi fins que des autocollants.20De plus, les diodes à avalanche à photon unique (SPAD) permettront l'imagerie dans des conditions de lumière nulle (comptage de photons).20

Reconnaissance des émotions et des intentions

D’ici 2030, les caméras ne seront plus seulement des outils visuels :

-

Surveillance biométrique :Utilisation de vibromètres Doppler laser longue portée pour capturer les battements cardiaques et la respiration.55

-

Analyse des émotions :Les réseaux neuronaux profonds analyseront les micro-expressions et le langage corporel pour effectuer une « prédiction d'intention » avant qu'un crime ne se produise.55

-

Autonomie de pointe :Avec la 5G/6G et les puces IA basse consommation, les caméras agiront comme des « gardes numériques », effectuant toutes les analyses localement et téléchargeant des données cryptées via des protocoles quantiques.3

Conclusion : un siècle résumé dans l’ombre et la lumière

L’évolution des caméras de sécurité est l’histoire de la quête sans fin de « visibilité » de l’humanité. D'une machine de bunker de 1942 au terminal actuel alimenté par l'IA avec fusion au niveau des pixels et vision nocturne couleur, chaque étape a été un triomphe sur les limites physiques. Les lentilles sont passées de sphériques à asphériques et les iris de manuels à P-iris ; les capteurs sont passés des tubes volumineux au BSI CMOS et à la détection quantique ; La technologie PCB est passée de simples connexions à des plates-formes SoC hautes performances.

L’avenir de la sécurité ne sera pas une collection de matériel froid mais une fusion de la physique, des semi-conducteurs et de l’IA. Tout en protégeant la société, le véritable défi de la prochaine décennie sera de trouver un équilibre entre progrès technologique et éthique de la vie privée.